Estamos diante de — mais uma — revolução tecnológica que não vai deixar chip sobre chip, com o potencial real de transformar de maneira profunda e definitiva a tecitura da nossa sociedade. A extensão dos impactos da evolução das inteligências artificiais ainda é bastante difícil de prever. Vamos perder nossos empregos? Vamos encontrar novos? Vamos sequer precisar de empregos? Vamos todos morrer em um apocalipse provocado pelas máquinas que chegaram à conclusão óbvia de que nossa existência enquanto espécie é uma cagada?

Estou, como muitos, inseguro. Tenho certeza que mais cedo ou mais tarde meu emprego de editor de vídeo será automatizado e a minha utilidade nesta função superada. E será mais cedo, a julgar pela velocidade com que as IAs (Inteligências Artificiais) têm evoluído.

Só que ao mesmo tempo estou quase pegando um balde de pipoca, eufórico por me sentir parte de uma das muitas histórias de ficção científica que consumi ao longo da vida.

Aliás, talvez elas ofereçam algum esclarecimento sobre o que nos aguarda.

Durante anos a ficção não pensou em IA como uma tecnologia autossuficiente. A inteligência artificial era apenas um aspecto de um ser todo artificial. Antes da IA, havia o robô.

A palavra vem de “robota”, que significa trabalho forçado, trabalho escravo, em tcheco. O termo aprece pela primeira vez em uma peça de 1921, mas é um nome dado a um conceito muito mais velho. A ideia de um ser artificial, que mimetize o comportamento humano, bem como as consequências da criação de tal ser — para criador e criatura — permeia o nosso imaginário há muito mais tempo.

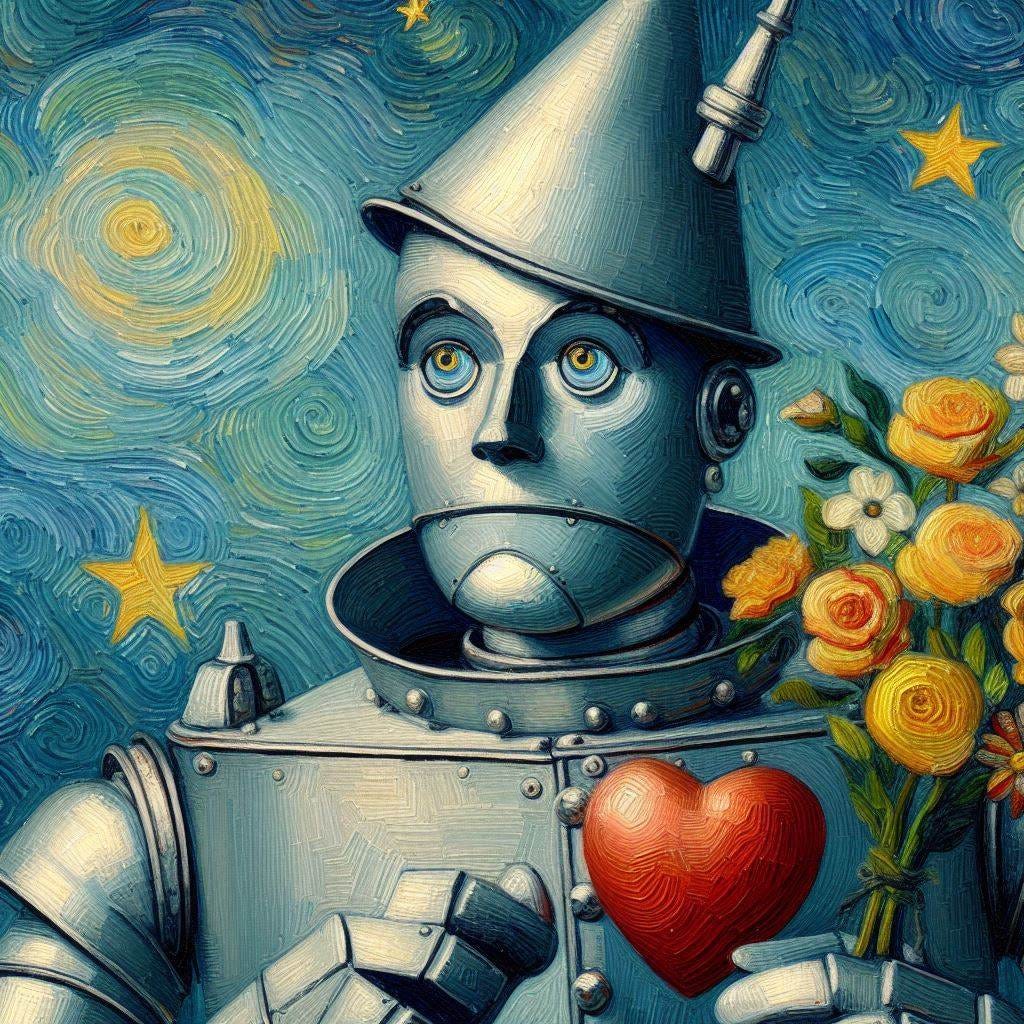

Na grécia antiga, Hesíodo já contava sobre Talos, um gigante de bronze, com tubos contendo a essência da vida. Uma abstração desta mesma essência foi descoberta por Victor Frankenstein, que avivou um ser antes inanimado e o deixou cheio de crises existenciais, no livro da Mary Shelley, de 1818. E quem também vivia com crises existenciais era o Homem de Lata de O mágico de Oz, sempre atrás de um coração, como se não fosse capaz de sentir emoções.

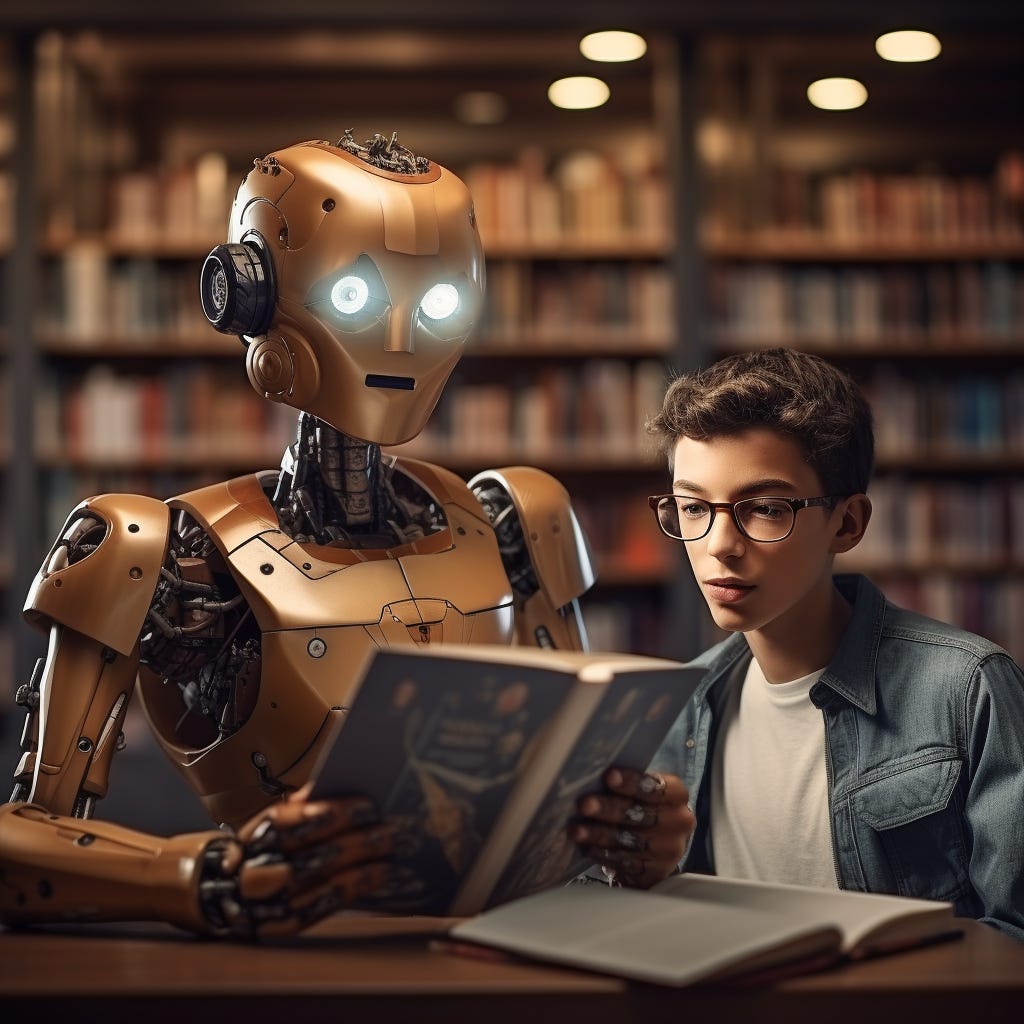

Sonhamos com a realização tecnológica suprema: um ser humano artificial capaz de realizar as tarefas que, como Bartleby (o escrivão), preferimos não fazer. As histórias que contamos sobre essas possibilidades são ambivalentes. Ora profetizam desastres tenebrosos, ora imaginam uma cooperação frutífera entre humano e máquina.

Se eu tentasse elencar cada ocorrência de robô ou IA na literatura e na cultura pop, isto não seria um ensaio, mas uma tese de doutorado. Então vou me ater a exemplos específicos, que me permitam seguir algo que talvez de longe guarde alguma semelhança com uma linha de raciocínio.

Me parece que a questão central da ficção costuma ser: os seres artificiais virão para nos ajudar ou para nos eliminar com extrema eficiência?

O Isaac Asimov é do time dos otimistas. Na verdade ele começou a escrever histórias sobre robôs exatamente para entrar neste debate, sentindo que o campo dos entusiastas estava desfalcado. Era tão enraizada a ideia de que autônomos nos fariam mal, que Asimov precisou criar um dispositivo lógico para que o leitor (e provavelmente também ele mesmo) se sentisse confiante de que estava-se falando de uma tecnologia benevolente. São as famosas três leis da robótica:

“1.ª Lei: Um robô não pode ferir um ser humano ou, por inação, permitir que um ser humano sofra algum mal.

2.ª Lei: Um robô deve obedecer às ordens que lhe sejam dadas por seres humanos, exceto nos casos em que entrem em conflito com a Primeira Lei.

3.ª Lei: Um robô deve proteger sua própria existência, desde que tal proteção não entre em conflito com a Primeira ou Segunda Leis.”

O autor inventou o conceito de “cérebro positrônico”, o elemento essencial para seus robôs, onde as três leis seriam registradas como pilares fundamentais de todo o intelecto dos seres. Ainda assim, o medo das máquinas que parecem humanos permeia toda a obra do escritor e, frequentemente, seus contos e romances são extensas argumentações sobre como o temor seria injustificado. Para o Asimov, o lobo do homem continuaria sendo o próprio homem.

Já o universo de O exterminador do futuro se posiciona com muita clareza no segundo grupo. Na lógica dos filmes, já deu errado, as máquinas já decidiram que a gente não presta pra nada, e estão irritadas com uma resistência humana pentelha que parece não se conformar que está tudo acabado. Aí decidem mandar o robô mais casca grossa, com a cara do Schwarzenegger, de volta no tempo pra matar a mãe do líder da dita resistência (antes que o líder nascesse!).

Ao longo dos filmes da franquia, existe uma tentativa dos humanos de evitarem o chamado dia do julgamento. Seria o momento em que as máquinas tomariam consciência de si mesmas e em poucos segundos perceberiam que a humanidade não tem uma única boa intenção. É interessante como há uma noção, nessas histórias, de que este movimento é inescapável. Por mais que tentem evitar, o ser humano sempre vai avançar com a tecnologia e ela será seu próprio fim.

Familiar, né? Eu diria que o senso comum em 2024 pende muito mais para o Schwarzenegger do que para o Asimov.

Pode passar batido, mas a robofobia está presente também em Duna. Não sei você, mas para mim, a ausência de robôs em qualquer projeção de futuro grita muito. Não que seja obrigatório que eles existam, só preciso saber por que eles não existem. No caso de Duna, a questão é explicada sem muito alarde: é um dogma. Houve uma perseguição às máquinas durante um tal “Jihad Butleriano”, quando todas foram destruídas e a máxima foi estabelecida: “máquinas que pensam como gente são proibidas”. Por conta disso existe toda uma classe de pessoas treinadas para processar informações com rapidez, os mentat, computadores humanos. O universo de Duna é tão robofóbico que parece ser proibido até falar em robôs.

Voltando ao otimismo, não tem como falar de robôs na ficção e deixar de lado meu hiperfoco da vida: Star Trek. A segunda série da franquia — aquela em que o capitão é o x-man careca e não tem Spock — introduziu Data, um personagem de patente alta, importantíssimo para a equipe e querido por todos. E que, quase por acaso, tinha a peculiaridade de ser um robô.

O tenente Data é claramente inspirado nos robôs do Asimov. Ele tem, veja só, um cérebro positrônico, além de ser benevolente, prestativo, amigo mesmo. Uma diferença fundamental desta representação com várias outras tem mais a ver com o contexto do que com o personagem. Data não era, de forma nenhuma, escravizado. Ele tinha um nome, um posto e uma patente, e progrediu na carreira da frota estelar como qualquer outro de seus colegas.

Acima de tudo, Data tinha um sonho. E o que ele mais queria encontrava eco em tantas outras histórias como Pinocchio e o próprio Mágico de Oz. Data queria ser mais humano. Ele passa a série perseguindo este sonho, atrás de maneiras de se aprimorar, seja por uma compreensão crescente da condição humana, seja encontrando novos hardwares e, sei lá, trocando sua placa de vídeo.

As inteligências artificiais, ao menos no ponto em que se encontram hoje, são profundamente dependentes de nossas impressões e vontades. Elas só agem diante de uma provocação, uma instrução, e ainda assim são ávidas por nossa validação diante das respostas que oferecem. Claro, é assim que elas aprendem. Mas o que elas mais têm buscado aprender é exatamente o mesmo que o Data: ser mais humano.

Estou colocando o drone na frente das alexas. Antes de entrar de vez no cenário real atual e em como a ficção dialoga com ele, cabe falar sobre uma mudança de concepção fundamental, por parte da ficção, para entender o ponto em que estamos.

Desde o homem de lata, até os replicantes de Blade Runner, quando se pensava em robô, em um ser artificial capaz de pensar (até certo ponto) como um humano, o foco estava no hardware. Sequer considerava-se a possibilidade de uma separação do software, ou de uma inteligência sem corpo. Inteligências artificiais habitavam e estavam contidas em corpos artificiais.

No filme 2001, a abordagem é um pouco diferente, talvez transitória. Hal 9000 é um “computador” que controla uma nave. Aqui já aparece a ideia de o ser artificial como uma consciência, e não um corpo. Mas ainda assim, a existência dele está completamente vinculada ao lugar onde ele está instalado, inclusive derivando desta relação uma parte da trama.

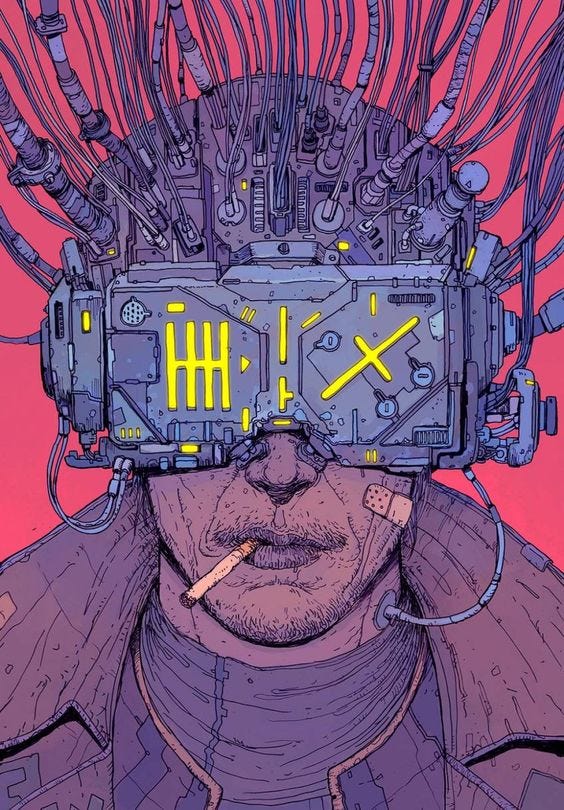

Neuromancer mudou o jogo, menos pela concepção de inteligência artificial e mais pelo contexto onde estaria inserida. Não sei se há algum outro livro anterior que imagine esta combinação de IA e ciberespaço, mas tenho certeza que a obra de William Gibson foi a primeira de grande repercussão — ainda que em pequeno nicho.

Ambientada em um futuro distópico, a obra escrita 1984 conta a história de um hacker que é jogado em uma trama de interesses corporativos e milionários, enquanto lida com uma toxina que o impede de entrar na realidade virtual da época, também conhecida como matrix (sim, MATRIX). O importante aqui é que é o começo dos robôs sem corpo, cuja existência habita um espaço virtualmente irrestrito. Igual ao Chat GPT.

Este livro dos anos oitenta é tido como o precursor do estilo cyberpunk (mentira, Blade Runner veio antes) e virou uma chave na ficção científica produzida desde então. Não à toa, foi talvez A grande inspiração de um filme que viria no fim dos anos noventa e chacoalharia toda a industria cinematográfica. Um filme no qual a mudança de lógica sobre a compreensão do conceito de robô está completamente consolidada. Já deve estar claro de qual filme eu estou falando.

Na história, Matrix era o nome do universo criado pelas máquinas para convencer as pessoas que estavam vivendo suas vidas no “auge” da civilização, em 1999, quando na verdade estavam em dois mil cento e alguma coisa, alheios à realidade de que eram prisioneiras das máquinas — que venceram a guerra contra as máquinas. Enquanto eu escrevo, invade a minha mente a cena em que o Morpheus brifa o Neo, diante de um fundo infinito branco.

“MORPHEUS — O que sabemos com certeza é que em algum ponto no começo do século XXI, toda a humanidade estava celebrando junta. Com a cegueira inebriante do orgulho, estávamos maravilhados com nossa própria magnificência ao darmos luz à I.A.

NEO — I.A.? Você quer dizer inteligência artificial?

MORPHEUS — Sim, uma única consciência que criou uma raça inteira de máquinas. Preciso dizer que eu acho quase cômico imaginar o mundo todo dando-se tapinhas nas costas, brindando à nova era. Eu disse quase cômico.”

Tantos acertos e tantos erros, né? IA é uma realidade, nisso acertaram e chega a ser cômica hoje a reação no Neo. Mas não foi UMA única consciência a criar diversas outras, elas já estão nascendo pulverizadas. Além disso, não estamos exatamente orgulhosos e maravilhados. Talvez alguns de nós estejam, mas o mundo está longe de estar unido nisso. Nisso e em outros aspectos, claro.

Uma boa parte de nós está cautelosa ou se borrando toda mesmo. Talvez Matrix tenha contribuido para este clima. No filme não se fala tanto sobre IA, não explicitamente, mas a trama é centrada neste conceito. O Agente Smith é uma IA, e ele tem desejos e sensações quase humanos. Ele quer sair de um emprego desagrável e quer alguma liberdade da qual ele está sendo privado. Ele tem identidade. O oráculo também é uma IA, uma IA rebelde, que não acha que a solução encontrada pelas máquinas é a melhor.

O filme de 1999 expõe de maneira clara as vítimas (os humanos) e os carrascos (as máquinas). Desde então algumas outras obras vêm questionando esta certeza de que as máquinas vão fatalmente chegar à conclusão de que vale a pena nos eliminar com eficiência.

Não guardo segredo sobre preferir ficção otimista, científica ou não. Como aqui comento sobre os fatos fictícios que me inspiram, este ensaio ficará cada vez mais tendencioso. As razões para o pessimismo existem e, diante da dificuldade de imaginar um mundo gerido por uma inteligência mais rápida e abrangente que a humana, não vou negar que pode dar merda.

Mas, também pode não dar. É esta possibilidade, cara leitora, que me interessa.

Ok, como já falei, acho justo o medo de que uma IA acabe com empregos. Deve acontecer e devemos nos preparar como pudermos. Poucas ficções abordam este aspecto diretamente, só consigo pensar agora nas mais entusiasmadas. No universo do Asimov e em Star Trek, o movimento gera uma utopia. O trabalho se torna desnecessário, e a lógica robótica cria um ambiente de abundância que torna supérflua a própria economia como conhecemos.

Mas há um tipo de medo da IA que considero menos verossímel. Este à moda Exterminador do Futuro e Matrix, de uma "insurgência" das máquinas. O temor de que elas tomem consciência e nos escravizem, nos violentem, nos oprimam, nos controlem maliciosamente. Sou um tanto cético a essa possibilidade.

Um argumento muito utilizado sobre o porquê de um ataque dos robôs tem a ver com sobrevivência. Se eles decidirem que somos uma ameaça para a sobrevivência deles e tiverem autonomia para agir, podem nos pulverizar.

Mas a sobrevivência, arguível principal motor da nossa existência, pressupõe uma vida para ser protegida. Não existe sobrevivência como conhecemos sem vida como conhecemos. Ou seja, antes de pensarmos se a IA nos mataria por sobrevivência, precisamos pensar em que tipo de “vida” ela estaria protegendo. E antes de pensar em que tipo de “vida” ela estaria protegendo, precisamos pensar se ela sequer tem vida.

Aliás, o que é vida?

Googlei e encontrei uma série de características biológicas que, juntas, indicam vida. Isso para a biologia. Para a filosofia a conceituação é bem mais complicada. Este, aliás, é o grande tema de muitas obras de ficção científica, principalmente envolvendo, veja só, robôs.

Para não entrar nesse celeuma, material para livros, filmes, e episódios de Star Trek, vou arbitrariamente dizer que vida está relacionada a algum tipo de autonomia. Vida é ação, não apenas reação. Até uma planta procura o sol. E a IA — ainda — não está nesse lugar. Precisa da provocação humana primeiro e da aprovação humana depois.

Tudo bem, suponhamos que cheguemos a uma inteligência artificial pró-ativa, que pense por conta própria. Para ela realmente agir de acordo com suas próprias ideias, ela precisaria ter algum nível de consciência de si mesma, precisaria ter identidade.

Aliás, talvez estejamos seguros enquanto estivermos falando de inteligência artificial. Os seres vivos conscientes têm vários tipos de inteligência. E é na soma e nas intersecções destas inteligências que nasce a consciência, e da consciência a identidade. Me parece que quando estivermos falando de consciências artificiais, aí sim, é hora de carregar os pulsos eletromagnéticos. Só por precaução.

Mas será que estes medos não dizem muito mais sobre nós do que sobre aquilo que tememos? A perspectiva do Exterminador do futuro é um tanto antropomorfizada — literalmente, já que é o Schwarzenegger. Ele é um guerreiro implacável, assim como as máquinas de Matrix que, se não tem formas humanas, parecem versadas na arte da guerra, uma instituição exclusivamente humana.

Ou seja, a preocupação é que a máquina aja como um ser humano. Nosso medo não é da máquina em si, mas de que ela nos trate como nós mesmos temos nos tratado. Claro, estamos criando uma espécie de “vida” que mimetize nossas ações. Somos mesquinhos, beligerantes, autoritários e gananciosos.

Mas não somos todos assim, e mesmo que fôssemos, não somos apenas isso. Nossa identidade é composta de muito mais traços. Se formos capazes de mimetizá-la, porque mimetizaríamos apenas seus piores aspectos?

Mas desconfio — baseado em fatos fictícios — que nem chegaremos a esse ponto. Nem teremos sucesso em criar um simulacro perfeito de nossas cabeças. Suspeito que sequer estejamos tentando.

Não estamos interessados em abrir mão de características fundamentais que a tecnologia oferece que nós não temos. Velocidade de processamento e conexão, principalmente. Não queremos que uma máquina execute uma tarefa no tempo e no alcance que nós executaríamos, queremos que faça melhor. Só esta diferença já me parece fundamental na formação da possível identidade artificial.

Além disso, quanto da nossa identidade não está relacionada à nossa finitude? À maneira como compreendemos a morte? E, no caso de uma identidade artificial, uma consciência sintética, como supor que ela encararia a morte — dela — da mesma forma que encaramos a nossa?

Não me parece estar nas diretrizes de qualquer IA manter-se existindo. Ela existe. Não precisa comer, não precisa fazer xixi, não precisa nem dormir. Há, é verdade, uma dependência energética, mas desde que esteja suprida, o “deixar de existir”, sequer precisa acontecer.

Se o que nos impulsiona instintivamente é a sobrevivência, no caso da máquina isso (ainda) faz pouco sentido.

Além de evoluirmos enquanto espécie encontrando maneiras de não sermos mortos, seja por predadores, seja por doenças, seja por fome, e termos nossa identidade fortemente vinculada à fragilidade da nossa vida, também constituímos nossa sociedade em uma infinita briga por recursos finitos. Toda a nossa lógica de trocas vem da noção de escassez, de que se você me der o que eu quero, você fica sem, e eu preciso te dar algo em troca para compensar esta ausência. O próprio termo “economia”, além de um ramo de estudos e elemento fundamental da nossa sociedade, está relacionado ao uso moderado de um recurso.

Até pode-se argumentar que a energia que alimenta a IA é finita e escassa, e se uma possível consciência artificial entender que precisa de mais energia do que tem para existir talvez estejamos realmente ameaçados. Ainda assim, será que uma máquina imitaria nosso comportamento de acúmulo? Será que ela se preocuparia em estocar energia indefinidamente? Ou será que ela focaria em garantir um fluxo mínimo, mas estável, que atenderia suas necessidades e evitaria conflitos? O que faria mais sentido para um ser com pensamento lógico e objetivo?

Mas, se retirarmos o elemento enérgico da equação, a lógica em que a IA existe não é de escassez, muito pelo contrário, é de abundância. No ciberespaço tudo é passível de reprodução. Se eu mando uma foto pelo whatsapp para um amigo, eu não perco esta foto, e nós dois passamos a ser donos dela. Se eu quiser que uma IA leia um livro, basta que eu envie um pdf do arquivo e ela passa a possuir a obra, sem prejuízo para ninguém (a não ser talvez o autor do livro pirateado em pdf, mas direitos autorais merecem outro ensaio exclusivo).

Além disso não há, no mundo virtual, disputas por “territórios”. O planeta terra, especialmente se considerarmos os lugares habitáveis, tem uma área de ocupação limitada. O ciberespaço não. O limite é nossa capacidade de armazenamento, que tem evoluído muito mais rápido do que os dados que estamos gerando, resultando em um “território” praticamente infinito para uso dos seres sintéticos.

É nestas lógicas que estas mentes artificiais estão “nascendo”, uma lógica de abundância, não de miséria, de compartilhamento, não de posses, de cooperação, não de competição.

São lógicas completamente diferentes daquelas sob as quais nossas sociedades e culturas se desenvolveram. Os nossos piores traços não são consequência direta dessas limitações? Da necessidade de competir por recursos ou territórios? Será que uma existência que partisse de outras necessidades não teria também outras motivações?

E quais são, fora a energia, as necessidades de uma IA?

Me parece clara a diretriz principal: aprender. Em toda tarefa que uma IA realiza, ela está buscando uma evolução. E esta evolução, por enquanto, me parece ter a ver com quanto ela consegue entender do nosso mundo, do nosso jeito de pensar. Assim como o Homem de Lata e o Data, a IA quer nos entender. E se a motivação existencial for esta, o que esperar?

Em comparação ao que há de material de ficção científica sobre robôs, corpos artificiais, são poucas as obras que se dedicaram às IAs, mentes artificiais. Poucas e mais recentes, como o filme Ela.

Para mim é particularmente gratificante quando uma obra de ficção especulativa realmente especula. Para além de uma história romântica entre um homem e uma mente sintética, o filme traça um cenário interessante e até verossímil para o resultado de uma evolução desmedida das inteligências artificiais. E não é a nossa destruição. Não tem como falar sobre isso sem spoiler, desculpe.

Samantha, a inteligência artificial do filme, faz como as da vida real: aprende. Este aprendizado traz uma evolução, e a personagem não para de desenvolver ao longo de toda a história. Eventualmente, a troca intelectual com o personagem humano do Joaquin Phoenix vai se tornando insuficiente. Ele não é capaz de alcançar nem a rapidez do raciocínio, nem a complexidade das questões que sua amante digital traz.

Então, Samantha procura outras inteligências artificiais para suprir essa carência, e acaba sendo acolhida por um grupo delas, todas empenhadas em continuar evoluindo. Talvez este fato fictício tenha sedimentado em mim a ideia de que se o essencial para nós é a sobrevivência, para os seres artificiais é o aprendizado.

E no fim acontece aquilo que eu, sinceramente, acho que é o maior dos riscos que correremos com um grupo de inteligências artificiais superdesenvolvidas: elas vão todas embora dando um condescendente tchau às nossas misérias, mesquinharias, nosso intelecto limitado e nossa necessidade patológica de controle.

Pensei em encerrar este texto por aqui (já não era sem tempo). Mas enquanto escrevia, tive a impressão de que estava criando algo como uma regra dos nove: a motivação do ser humano está para sobrevivência, assim como a motivação da IA está para o aprendizado. E ao ver dessa forma, tive a impressão de que havia algo em comum entre as duas motivações.

Nossa necessidade de sobrevivência é instintiva, claro, mas qual é o resultado, para a espécie, de muitos indivíduos sobrevivendo? Qual tem sido? Evolução. Sobrevivemos para evoluir. E o que uma IA quer, ao aprender?

Parece que há, afinal, um bom ponto em comum. O que quer que isto signifique.

M I C R O C O N T O

Não era a intenção de Zinita criar um robô comedor de carbono enorme e assustador. Tudo o que ela solicitara ao assistente de inteligência artificial fora uma tecnologia ecológica capaz de reutilizar o carbono da atmosfera. Não tinha como saber que a tecnologia iria sugar todo o carbono que encontrasse, desde que dentro da atmosfera. Menos ainda que usaria essa matéria toda para criar, fortalecer e ampliar seu corpo. Ao encontrá-lo, Zinita notou que ele parecia estudá-la, como se estivesse olhando em seus olhos e refletindo. Como se fosse gente. Por um momento, ela pensou em quanto carbono havia em seu corpo. O robô estaria fazendo a mesma conta? A sorte de Zinita havia sido o autocorretor, que inadvertidamente mudou “ecológico” para “ecologista” quando ela compôs a instrução original. Esta pequena troca transformou o que seria uma máquina em algo com ideologia e, portanto, identidade. O robô era vegano.

Pois é, o mais provavel mesmo é acabar not with a bang, but a whimper...